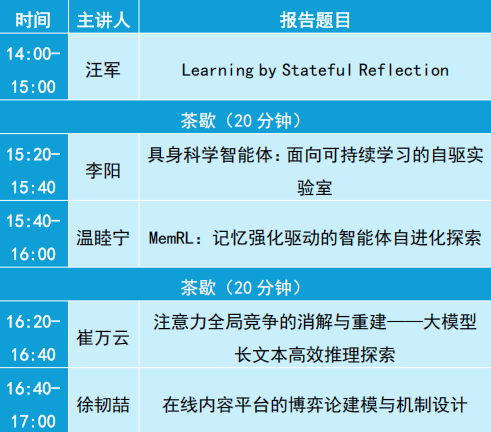

本次Workshop邀请了来自UCL、上交大与上财的顶尖学者,从“具身科学智能体”到“记忆强化决策”,共同探讨如何通过状态性反思与结构化经验,赋予智能体真正的持续学习与自进化能力。欢迎所有对本次议题感兴趣的老师、同学和业界朋友前来参会,共同探讨未来图景。 1 会议时间 2026年3月12日 2 会议地点 上海财经大学第三教学楼西段308会议室 Learning by Stateful Reflection Abstract We study continual experiential learning in Large Language Model (LLM) agents that integrate episodic memory with reinforcement learning. The central mechanism is reflection, where an agent uses past experiences to guide future decisions without modifying model parameters. Building on ideas from case-based reasoning and the Memento framework (Memento-1 and, Memento-2), we model learning as a memory-driven process in which agents store trajectories, cases, and reusable skills and retrieve them to improve decision making in new situations. To formalise this idea, we introduce the Stateful Reflective Decision Process (SRDP), where an agent maintains evolving memory and performs two operations: write, storing outcomes of interactions (policy evaluation), and read, retrieving relevant experiences to guide actions (policy improvement). We show how this read-write reflective learning can be integrated with reinforcement learning through retrieval-augmented policy iteration and prove that, as memory grows and increasingly covers the state space, the resulting policy converges to the optimal solution. This framework provides a principled foundation for memory-based LLM agents capable of continual adaptation during deployment. We will present our recent practical Memento-Skills agent system that is naturally integrated with existing industry scale LLM application. Bio Jun Wang is Professor at the Computer Science department, University College London. Prof. Jun Wang is a leading expert in AI, Machine Learning, and Multiagent Systems, with over 200 publications. His research has earned eight Best Paper awards, including SIGIR Test of Time and Honourable Mentions, and has led to widely adopted algorithms used by Ray and CERN for particle discovery. He won the first global real-time bidding contest (2013) and NeurIPS 2020 black-box optimisation challenge, with solutions now deployed in industry. His patents with BT enhance personalisation in recommender systems by dynamically adjusting training data. As co-founder and Chief Scientist of UCL spinout MediaGamma (2013–2020), he led the development of AI-driven audience decision tools, helping the company secure £5.8M in funding before its acquisition in 2020.

具身科学智能体:面向可持续学习的自驱实验室 Abstract 近年来,以自驱实验室(self-driving lab)为代表的全自动实验室系统在化学合成、材料发现和药物筛选等领域快速兴起,成为科学智能化的重要前沿方向。然而,一个关键瓶颈正在逐渐显现:现有自动化实验室虽然高度自动化,却几乎不具备真正的“持续学习能力”。认知参数在部署后往往被冻结,实验策略依赖人工编写规则,历史实验经验难以沉淀,每当面对新的科学问题时,系统往往需要重新设计流程、重新调参、重新探索。我们将这一现象称为“机构性失忆”(Institutional Amnesia):实验室能够自动执行,却无法持续成长。为突破这一限制,我们提出科学发现的第五范式,其核心是一种“可学习性三位一体”(Triad of Learnability)框架,包括认知可学习性、实验可学习性和具身可学习性三个相互协同的维度。三者协同,使实验室从静态自动化工具进化为持续成长的科学有机体。基于这一框架,我们构建了具身科学智能体(Embodied Scientific Agent, ESA),并自主搭建了一套双臂移动机器人实验平台。在电Fenton废水降解任务中,系统需要在超过2亿种参数组合的实验空间中寻找最优条件,ESA仅通过15轮实验便实现了99.7%的降解效率,将两名研究人员约30天的实验周期压缩至45小时,展示了可学习具身驱动的全自动实验室在加速科学发现方面的巨大潜力。 Bio 李阳,上海交通大学计算机学院约翰·霍普克罗夫特中心长聘教轨助理教授。2025年获英国曼彻斯特大学计算机科学博士学位,曾在华为伦敦研究所Agent Team担任研究科学家。主要研究方向为多智能体系统、具身智能与AI for Science,在ICML、NeurIPS、ICLR、CoRL、RAL等人工智能与机器人领域顶级会议及期刊发表学术论文10余篇,并担任多个顶会顶刊评审及领域主席。

MemRL:记忆强化驱动的智能体自进化探索 Abstract 面对大模型和智能体在持续迭代时面临的微调成本高、灾难性遗忘以及传统RAG方案缺乏最优效用评估等难题,本报告提出了一种全新的“大脑-记忆”双核智能体架构——MemRL。该架构系统性地将通用推理能力(“大脑”)与后天领域经验(“记忆”)解耦,在冻结大模型参数的基础上,外挂基于“意图-经验-效用”三元组的结构化经验池。通过引入作用于记忆的非参数化强化学习机制,MemRL能够利用真实环境反馈持续更新记忆内容与效用权重,真正赋予智能体“从运行时经验中学习”的能力。实验表明,该系统不仅在 Humanity's Last Exam (HLE) 通用任务上突破了60%的成功率,更在预训练知识严重匮乏的国产昇腾平台CANN算子生成任务中达到了80%以上的正确率,为实现低成本的非破坏性持续学习以及构建未来的“专家记忆”交易市场奠定了坚实的技术基础。 Bio 温睦宁,上海交通大学人工智能学院研究助理教授。主要研究强化学习、持续学习与大模型智能体等方向。在过往的学术生涯中,致力于开发先进的强化学习算法,以提升语言智能体或多智能体系统在动态环境中的序列决策能力。此外,还深入参与了这些算法在编程、数学以及算子开发等领域的应用研究。

注意力全局竞争的消解与重建 ——大模型长文本高效推理探索 Abstract 大模型长文本推理的核心挑战在于:Softmax Attention 的全局竞争机制赋予了模型精准检索的能力,但也带来了随序列长度爆炸的计算与存储开销。现有提效方案——无论是压缩 KV Cache 还是采用线性注意力——都在不同程度上损害了这一关键能力。本次报告围绕"如何在效率约束下保护与重建注意力的全局竞争"这一核心问题,介绍我们在三个层面的工作:表征层,揭示 KV Cache 的键值非对称性并提出无损压缩框架 AsymKV;优化层,通过压缩感知训练让模型主动适应推理压缩;架构层,在线性注意力中以 Head 级 Softmax 重建全局竞争。三者统一于"表征—优化—架构"协同进化的研究框架。 Bio 崔万云,上海财经大学计算机与人工智能学院常任副教授,研究兴趣是大语言模型推理,获AI2000最具影响力学者提名,ACM中国优博提名奖、ACM上海优博奖。在NeurIPS、ICLR、ACL等会议上发表论文二十余篇。主持国家及上海市自然科学基金项目、上海市青年扬帆学者项目等。

在线内容平台的博弈论建模与机制设计 Abstract 在线内容平台,如抖音、小红书等,已经深度融入人们的日常生活,并持续影响用户的信息获取、消费选择与行为决策。传统研究通常将平台问题聚焦于用户兴趣建模与个性化推荐优化,核心目标在于提升推荐的准确性与匹配效率。然而,当前内容平台本质上已演化为一个由平台算法、用户与内容生产者共同构成的复杂生态系统。内容创作者围绕流量与曝光展开策略性竞争,平台算法则会进一步影响内容供给与用户兴趣,从而形成多主体互动、持续反馈的动态结构。本报告将从博弈论视角出发,分析推荐平台中内容生产者之间的策略互动与均衡行为,并进一步探讨如何通过机制设计优化平台激励,进而对平台内容生态进行有效引导。 Bio 徐韧喆,上海财经大学计算机与人工智能学院助理教授。本科与博士均毕业于清华大学计算机科学与技术系,曾赴美国杜克大学计算机系理论组访问交流。其研究方向主要包括算法博弈论与机器学习,已在人工智能领域重要国际会议与期刊发表论文20余篇,包括 Nature Machine Intelligence、ICML、NeurIPS、ICLR 等,曾获 WINE 2025 最佳论文奖